学术报告:ICASSP 2026 论文预讲会

时间:2026/4/28 [周二] 晚上19:00 ~ 20:30

地点:线上

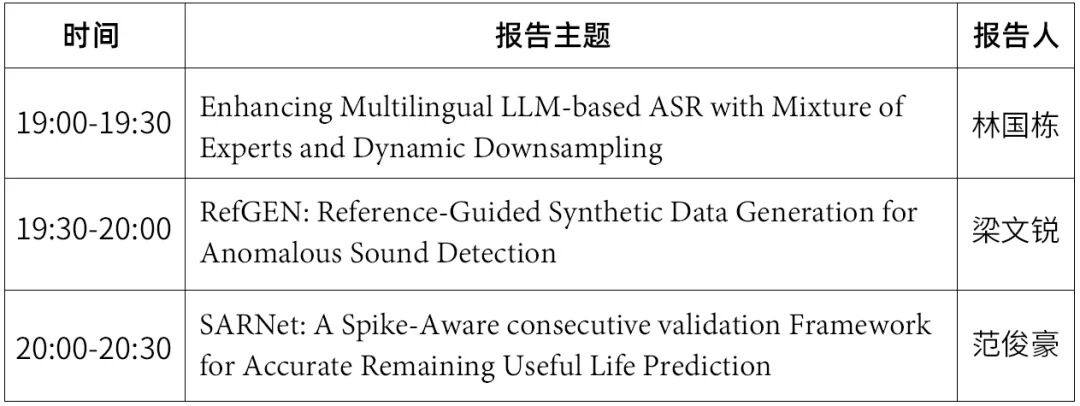

日程:

林国栋

嘉宾简介:清华大学SATLab二年级硕士生,研究方向为多语言语音识别。

报告题目:Enhancing Multilingual LLM-based ASR with Mixture of Experts and Dynamic Downsampling

摘要:大语言模型(LLMs)的飞速发展,为自动语音识别(ASR)开辟了全新研究领域,如何实现二者的高效融合,已成为一项关键且极具挑战性的研究方向。针对多语言泛化与模态对齐两大核心难题,本文提出一种基于映射器的大语言模型 - 自动语音识别融合框架。该方案引入混合专家(MoE)架构以提升跨语言适配能力,同时结合连续积分触发(CIF)机制完成动态下采样与模态对齐。实验结果表明,上述模块的组合能够显著提升模型性能,效果优于各类主流基线模型。该研究方法为构建高精度、强鲁棒性与高泛化性的大语言模型驱动型语音识别系统奠定了重要基础。

论文链接:doi: 10.1109/ICASSP55912.2026.11464266

梁文锐

嘉宾简介:清华大学SATLab二年级硕士生,研究方向为异常声音检测。

报告题目:RefGEN: Reference-Guided Synthetic Data Generation for Anomalous Sound Detection

摘要:在工业应用中,由于存在域偏移(domain shift)问题,异常声音检测(ASD)面临着巨大挑战,尤其是在目标域训练数据稀缺的情况下。基于文本到音频(TTA)生成技术的最新进展,我们提出了RefGEN——一种参考引导的生成框架,该框架引入了两项关键创新。首先,通过将参考音频编码为潜在空间中的声学锚点以引导生成过程,RefGEN能够生成比纯文本生成方法更逼真且更多样化的样本。其次,该框架结合了语义一致性过滤机制,利用基于BEATs的分类器剔除语义不匹配的输出结果,从而确保合成数据的质量与标签保真度。在DCASE 2023 ASD数据集上的实验表明,RefGEN的调和平均数(harmonic mean)性能达到了72.12%,优于多个强基线模型。消融实验证实了各个组件的有效性。

论文地址:doi: 10.1109/ICASSP55912.2026.11461896

范俊豪

嘉宾简介:密歇根大学工程与计算机学院一年级博士生,清华大学SATLab实习生,研究方向为运筹与优化、AI for Software Engineering,AI coding 评测及 Benchmark。

报告题目:SARNet: A Spike-Aware consecutive validation Framework for Accurate Remaining Useful Life Prediction

摘要:剩余使用寿命(Remaining Useful Life, RUL)的准确预测,对于提升系统可靠性、降低维护风险具有关键意义。然而,现有高性能模型在故障萌发阶段普遍存在两方面缺陷:一是对短时、高能量的脉冲信号易被平滑或误判,固定阈值也削弱了对异常的敏感度;二是预测结果缺乏物理解释,难以被工程师信任与复用。针对上述问题,本报告介绍所提出的 SARNet(脉冲感知连续验证框架)。该方法以Modern Temporal Convolutional Network(ModernTCN)为骨干,对退化敏感指标进行时序预测,并引入自适应连续阈值机制,在抑制噪声的同时保留真实脉冲,从而赋予模型物理层面的可解释性。对于被识别为故障前兆的片段,框架进一步进行针对性的特征工程,包括频谱斜率、统计导数、能量比等,最后由堆叠的 RF-LGBM回归器输出 RUL 估计。实验部分基于事件触发协议,在多个基准数据集上与近期主流方法进行对比。结果表明,SARNet在降低RMSE(0.0365)和MAE(0.0204)方面均优于现有基线,同时保持了轻量、鲁棒、易于部署的工程特性。